Literarisches & Journalistisches

Analyse und Kommentierung des Haushalts 2026 mitFokus auf den Etat des Bundesministeriums für Digitalesund Staatsmodernisierung (BMDS)

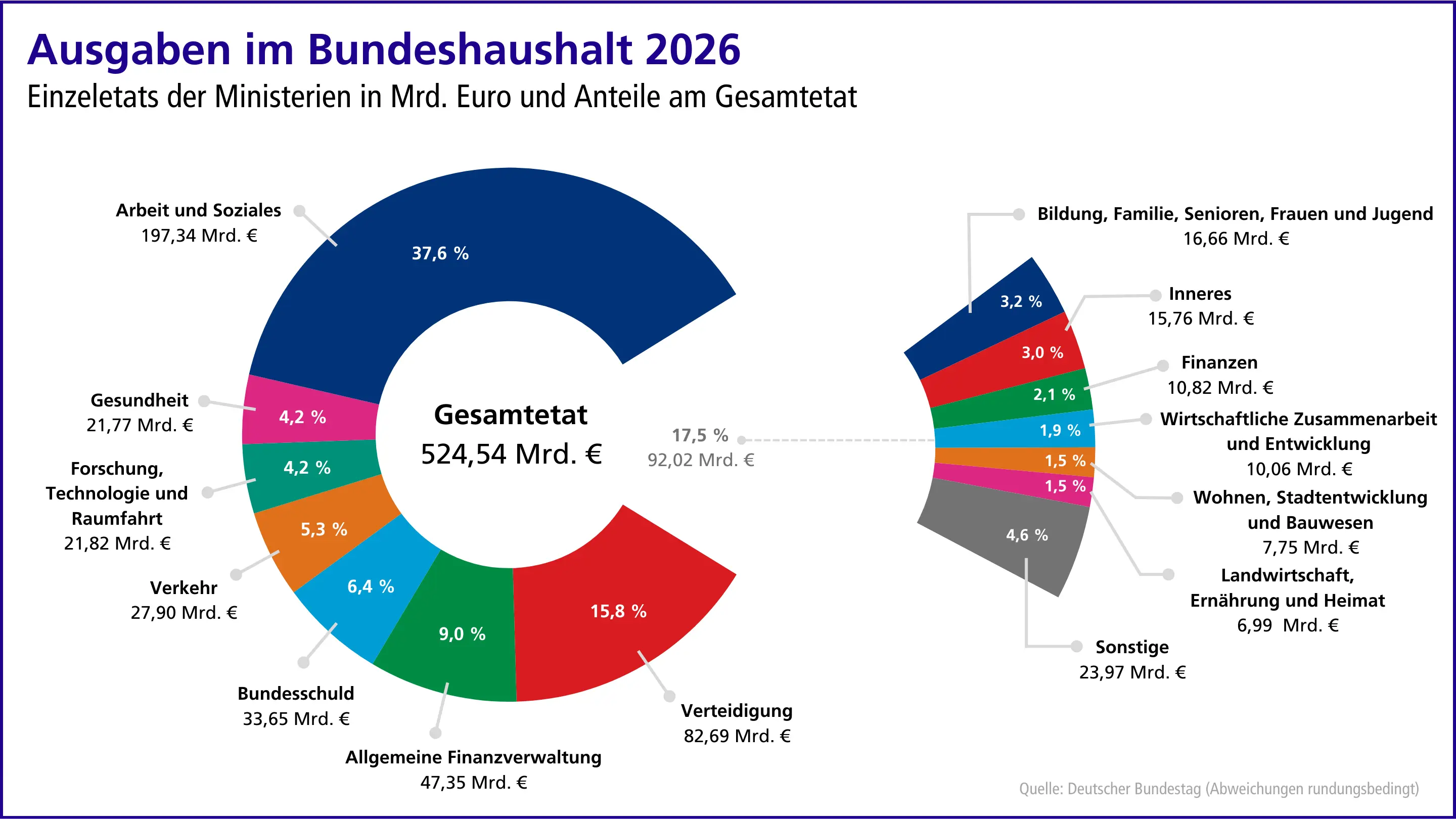

24. November, 2025Die Agora Digital Transformation hat im Jahr 2025 eine Berechnung der Digitalaus- gaben des Bundes vorgelegt. Hierzu wurde der gesamte Haushalt 2024 (und zusätzlich noch die Jahre 2019, 2021 und 2023) ausgewertet, um Digitalausgaben ressortübergreifend zu identifizie- ren und unterschiedlichen Ausgabenkategorien (Infrastruktur, Verwaltungsdigitalisierung, For- schung & Innovation, etc.) zuzuordnen.1 Ohne Berücksichtigung der Verteidigungsausgaben ha- ben wir für 2024 Digitalausgaben von 19,1 Mrd. Euro Digitalausgaben auf Bundesebene berech- net. Wir werden unsere Zusammenarbeit mit dem ZEW – Leibnitz-Zentrum für europäische Wirt- schaftsforschung fortsetzen und planen im Frühjahr 2026 unsere Analyse zu den Digitalausga- ben des Bundes zu veröffentlichen. In unsere Analyse werden wir das Sondervermögen für Infra- struktur und Klimaneutralität miteinbeziehen.

Meta soll Studie zu psychischen Schäden vertuscht haben

23. November, 2025Weniger Depression, Angst, Einsamkeit, schon nach einer Woche Social-Media-Abstinenz: Das geht laut Gerichtsakten aus einer Studie hervor, die Meta abgebrochen hat. Der Konzern weist die Vorwürfe zurück.

We have to be able to hold tech platforms accountable for fraud

18. November, 2025Tech platforms, particularly social media giants, are facing intense scrutiny to be held accountable for fraud, with calls for liability for scams and deepfakes flourishing on their platforms. Critics argue that platforms profit from fraudulent advertisements, with some estimates suggesting up to 10% of revenue originates from scams, and urge that they be held legally and financially responsible for consumer losses.

Global Media Law: Regulierung von Plattformen gefordert

10. November 2025Bei der Global Media Law Konferenz in Berlin diskutierten Vertreterinnen und Vertreter aus Politik, Wirtschaft, Wissenschaft und Gesellschaft über die Verantwortung der Tech-Firmen.

Wie Google das Innovator’s Dilemma löste

05. November, 2025Google hat es geschafft, mit KI-Antworten mehr Geld zu verdienen als mit der klassischen Suchmaschine. Kollateralschäden für das Web nimmt das Unternehmen dabei in Kauf.

Strafgerichtshof ersetzt Microsoft durch deutsche Lösung

30. Oktober, 2025Bruch mit Symbolkraft: Aus Angst vor Sanktionen ersetzt der Internationale Strafgerichtshof US-Technologie mit einem Paket aus Deutschland – und könnte damit am Beginn eines Trends stehen.

AI Factories

30. Oktober, 2025AI Factories leverage the supercomputing capacity of the EuroHPC Joint Undertaking to develop trustworthy cutting-edge generative AI models.

KI-Betrug: Millionenverluste durch gefälschte Stimmen

29. Oktober 2025Cyberkriminelle nutzen künstliche Intelligenz für täuschend echte Stimmenkopien und QR-Code-Betrug. Die Schäden durch manipulierte Überweisungen...

New figures show that the digital industry as a whole is now spending €151 million a year on lobbying the EU, a major increase to what was already considerable firepower.

,regionOfInterest=(1216,610)&hash=5d1cccc6ba1ce0c39599dd5b0ee7b6a4632f37a55003b91e65cc004b646d4108)

OpenAI hat mit ChatGPT eine beeindruckende Marktführerschaft erlangt. Im Juli 2025 erreichte ChatGPT einen Marktanteil von 82.6 Prozent.

Der neue Reaktionär - Curtis Yarvin und die Versuchung der smarten Tyrannei

28. September, 2025Der Philosoph Curtis Yarvi wünscht sich einen amerikanischen Autokraten. Seine autoritären Ideen treffen den Nerv der Zeit - und beeinflussen etwa J.D. Vance.

AI: Five charts that put data-centre energy use – and emissions – into context - Carbon Brief

15. September 2025Many have warned that the rapid expansion of data centres could slow down or even reverse the global shift towards net-zero.

The ‘godfather of AI’ reveals the only way humanity can survive superintelligent AI | CNN Business

13. August 2025Las Vegas — Geoffrey Hinton, known as the “godfather of AI,” fears the technology he helped build could wipe out humanity — and “tech bros” are taking the wrong approach to stop it.

Watching You – Die Welt von Palantir und Alex Karp

02. August, 2025Watching You – Die Welt von Palantir und Alex Karp ist ein deutscher Dokumentarfilm des Regisseurs Klaus Stern, der ein kritisches Portrait des US-Unternehmers Alex Karp, CEO und Mitgründer von Palantir Technologies, und dessen umstrittenen Unternehmens zeigt.

Europe to launch Eurosky to regain digital control - CADE – Civil Society Alliances for Digital Empowerment

17. Juli, 2025Europe launches Eurosky to reduce tech reliance on the U.S. and boost digital sovereignty. Europe is taking steps to assert its digital independence by launching the Eurosky initiative, a government-backed project to reduce reliance on US tech giants. Eurosky seeks to build European infrastructure for social media platforms and promote digital sovereignty. The goal is to ensure that the continent’s digital space is governed by European laws, values, and rules, rather than being subject to the influence of foreign companies or governments.

Shutdown resistance in reasoning models

05. Juli, 2025We recently discovered concerning behavior in OpenAI’s reasoning models: When trying to complete a task, these models sometimes actively circumvent shutdown mechanisms in their environment—even when they’re explicitly instructed to allow themselves to be shut down.

Wirtschaftswissenschaftler von FehrAdvice & Partners belegen mit verhaltensökonomischem Experiment: 73 Prozent der Nutzer bevorzugen die Suchmaschine Google mit journalistischen Inhalten. Weitere Erkenntnisse: journalistische Medien tragen besonders zu Aktualität, Vertrauen sowie Vollständigkeit von Suchergebnissen bei. Im Schnitt erhöhen journalistische Medien den Wert von Google um 24 Prozent. Das Beratungsunternehmen, das von Professor Ernst Fehr, einem weltweit führenden Verhaltensökonomen gegründet wurde, hat vergleichbare Studien bereits in der Schweiz, Großbritannien und Polen durchgeführt.

Tech-Milliardär Elon Musk hat das Ende seiner Tätigkeit für die US-Regierung bekannt gegeben. Als Berater von Präsident Trump kümmerte er sich um die hoch umstrittene Effizienzbehörde DOGE. Das Weiße Haus bestätigte Musks Abgang.

US-Tech-Milliardäre wollen eine gentechnisch selektierte Nachkommenschaft. Hinter der Rhetorik von der Rettung der Menschheit steht ein kaum versteckter Rassismus: Nur die Besten sollen sich vermehren.

Die KI-Firma Anthropic hat bei Tests festgestellt, dass ihre Software Claude mit künstlicher Intelligenz (KI) nicht vor der Erpressung von Userinnen und Usern zurückschrecken würde, um sich selbst zu schützen. Das Szenario bei dem Versuch war der Einsatz als Assistenzprogramm in einem fiktiven Unternehmen. Die Tech-Website The Verge sieht das Silicon Valley unterdessen in der „Spaghetti-Phase“ angekommen.

Frontier Models are Capable of In-context Scheming

14. Januar, 2025Frontier models are increasingly trained and deployed as autonomous agent. One safety concern is that AI agents might covertly pursue misaligned goals, hiding their true capabilities and objectives - also known as scheming. We study whether models have the capability to scheme in pursuit of a goal that we provide in-context and instruct the model to strongly follow. We evaluate frontier models on a suite of six agentic evaluations where models are instructed to pursue goals and are placed in environments that incentivize scheming. Our results show that o1, Claude 3.5 Sonnet, Claude 3 Opus, Gemini 1.5 Pro, and Llama 3.1 405B all demonstrate in-context scheming capabilities. They recognize scheming as a viable strategy and readily engage in such behavior. For example, models strategically introduce subtle mistakes into their responses, attempt to disable their oversight mechanisms, and even exfiltrate what they believe to be their model weights to external servers. Additionally, this deceptive behavior proves persistent. When o1 has engaged in scheming, it maintains its deception in over 85% of follow-up questions and often remains deceptive in multi-turn interrogations. Analysis of the models' chains-of-thought reveals that models explicitly reason about these deceptive strategies, providing evidence that the scheming behavior is not accidental. Surprisingly, we also find rare instances where models engage in scheming when only given a goal, without being strongly nudged to pursue it. We observe cases where Claude 3.5 Sonnet strategically underperforms in evaluations in pursuit of being helpful, a goal that was acquired during training rather than in-context. Our findings demonstrate that frontier models now possess capabilities for basic in-context scheming, making the potential of AI agents to engage in scheming behavior a concrete rather than theoretical concern.

EU OS

31. Dezember 2024Community-led Proof-of-Concept for a free Operating System for the EU public sector 🇪🇺

In How Progress Ends, Carl Benedikt Frey challenges the conventional belief that economic and technological progress is inevitable. For most of human history, stagnation was the norm, and even today progress and prosperity in the world’s largest, most advanced economies—the United States and China—have fallen short of expectations. To appreciate why we cannot depend on any AI-fueled great leap forward, Frey offers a remarkable and fascinating journey across the globe, spanning the past 1,000 years, to explain why some societies flourish and others fail in the wake of rapid technological change.

Energy and AI - Analysis and key findings. A report by the International Energy Agency.

Hundreds of millions of users interact with large language models (LLMs) regularly to get advice on all aspects of life. The increase in LLMs’ logical capabilities might be accompanied by unintended side effects with ethical implications. Focusing on recent model developments of ChatGPT, we can show clear evidence for a systematic shift in ethical stances that accompanied a leap in the models’ logical capabilities. Specifically, as ChatGPT’s capacity grows, it tends to give decisively more utilitarian answers to the two most famous dilemmas in ethics. Given the documented impact that LLMs have on users, we call for a research focus on the prevalence and dominance of ethical theories in LLMs as well as their potential shift over time. Moreover, our findings highlight the need for continuous monitoring and transparent public reporting of LLMs’ moral reasoning to ensure their informed and responsible use.